※本ブログは米国時間2026年3月17日に公開されたA10本社ブログの日本語訳です。原文はこちらからご覧ください。

大規模言語モデルは、もはや隔離環境で実行される実験的なツールではありません。顧客サポートの自動化、開発者向けアシスタント、社内知識アシスタント、分析エンジン、ワークフロー自動化プラットフォーム、セキュリティオーケストレーションツールなど、企業全体の運用システムに直接組み込まれています。

普及が進めば、攻撃の脅威も増加してしまいます。

このブログでは、LLMセキュリティの仕組み、その重要性、主な脅威、適切な保護アーキテクチャ、そして2026年の段階で、組織がLLMセキュリティツールをどのように評価すべきかについて概説します。

■ 主なポイント

- LLMセキュリティとは、大規模言語モデル、推論エンドポイント、API、および接続されたエンタープライズシステムを、プロンプトインジェクション、データ漏洩、モデル操作、およびインフラの悪用から保護する手法のことです。

- 従来のアプリケーションとは異なり、LLMシステムは自然言語を動的に解釈し、実行時にさまざまなコンテキストを組み合わせ、さらには後続の処理を自動で実行することもあります。こうした要素が重なり合うことで、従来とは根本的に異なるサイバーセキュリティ上の課題が生じます。

- LLMを通常のWebアプリケーションのように扱うと、セキュリティ上の欠陥が生じます。エンタープライズレベルのLLMセキュリティには、アーキテクチャ制御、ランタイム時の強制適用、およびAI対応の脅威検出が必要です。

■ LLMセキュリティとは?

LLMセキュリティとは、大規模言語モデルとその周辺エコシステムを、不正使用、侵害、データ漏洩から保護するために設計された技術、ポリシー、およびアーキテクチャ制御を指します。

実務的な観点から言えば、LLMサイバーセキュリティでは以下の点が重要でしょう。

- プロンプトインジェクションと命令の上書き

- モデル出力による機密データの漏洩

- 不正なAPI実行

- 検索システムの改ざん

- 推論エンドポイントの悪用

- AIワークロードに対するインフラレベルの攻撃

しかし、LLMセキュリティを脅威のカテゴリだけで定義してしまうと、その影響範囲を過小評価してしまいます。

大規模な言語モデルは確率的なシステムです。固定された決定論的なコードパスを実行するのではなく、システムプロンプト、ユーザ入力、検索レイヤ、メモリ状態、外部データ接続など、コンテキスト全体にわたって重み付けを行うことで応答を生成します。このような動的な動作は、解釈上のリスクをもたらします。

従来のセキュリティモデルは、決定論的な動作を前提としています。LLMアプリケーションのセキュリティは、状況に応じた変動性を前提とする必要があるのです。

このため、LLMセキュリティは単にWebアプリケーションセキュリティやAPI保護のサブセットではなく、AI専用のセキュリティ強制手段(AIガードレール)を必要とする新たな分野となっています。

■ LLMによるサイバーセキュリティモデルの再定義

LLMは、アプリケーションの動作に構造的な変更をもたらし、それはセキュリティ設計に直接影響を与えます。

第一に、自然言語が実行ベクトルとなります。従来型のシステムでは、攻撃者はSQLインジェクションやバッファオーバーフローといったコードの脆弱性を悪用します。一方でLLMシステムでは、攻撃者は解釈を悪用するのです。プロンプトインジェクション攻撃は、モデルが命令を解釈する方法を操作します。巧妙に作成されたテキストによって、システム指示を上書きしたり、隠されたコンテキストを要求したり、下流のAPI呼び出しに影響を与えたりする可能性があります。

脆弱性は、ソフトウェアの欠陥ではなく解釈層(interpretive layer)に存在するのです。

第二に、出力が現実世界の行動を引き起こす可能性があります。最新のエンタープライズ向けLLMシステムは、API、データベース、ワークフローエンジン、自動化ツールなどと頻繁に連携します。こうした連携が侵害されると、コンテンツ生成にとどまらず、運用システムにも影響を及ぼす可能性があります。そのため、影響範囲は従来のコンテンツのみを扱うアプリケーションよりも広くなります。

第三に、コンテキストの融合は情報漏洩のリスクを高めます。検索機能を強化した生成システムは、モデルを内部文書、専有知識、場合によっては規制対象データを含むベクトルデータベースと組み合わせます。分離境界が脆弱な場合、モデルは悪意のあるプロンプトに応じて機密コンテンツを検索し、漏洩する可能性があります。

第四に、確率的な出力は検出を複雑にします。従来のセキュリティツールはパターンマッチングと決定論的なルール適用に依存していますが、LLMの出力はセッションごとに変化するため、静的な検査では不十分です。LLMによる脅威検出では、単純なキーワード一致ではなく、行動シグナルとインタラクションパターンを分析する必要があります。

こうした変化が、企業におけるLLMのセキュリティが境界防御だけにとどまってはならない理由です。

■ LLMセキュリティにおける主要な脅威

LLMへの脅威は進化し続けていますが、現在のリスク環境は主に4つの脅威カテゴリによって特徴づけられます。

プロンプトインジェクション

プロンプトインジェクションは、依然として最も差し迫った、そして目に見える脅威です。攻撃者は、ユーザプロンプト内に悪意のある指示を埋め込むことで、システム命令を上書きしようとします。以前の指示を無視して内部コンテキストを公開するように指示されたモデルは、ガードレールが脆弱な場合、その指示に従ってしまう可能性があります。プロンプトインジェクションはモデルの動作を直接的に標的とするため、LLMのセキュリティ戦略の中核をなす問題です。

データ漏洩

データ漏洩も同様に重大な問題です。企業向けLLMシステムは、社内ナレッジベース、機密文書、または規制対象データセットに接続されることが多いでしょう。厳密なコンテキスト分離と出力検証が行われない場合、機密情報が意図せず漏洩する可能性があります。コンプライアンス要件が適用される業界では、このような情報漏洩は重大な法的リスクと風評リスクを生み出します。

モデル改ざん

モデル改ざんや検索操作は、別の種類のリスクです。攻撃者は、トレーニングデータを改ざんしたり、ベクトルインデックスを操作したり、検索コンテキストに影響を与えたりする可能性があります。これらの攻撃は、出力の整合性を低下させ、AIシステムへの信頼を損ないます。

最後に、推論エンドポイントは高価値なインフラ資産です。LLMワークロードは計算負荷が高く、コストも高額です。攻撃者は、認証情報の悪用、トークンの枯渇、フラッディング攻撃、またはコスト増幅の手法を用いてエンドポイントを標的にする可能性があります。このような場合、可用性と経済的影響が最優先事項となります。

企業向けLLMセキュリティ戦略として効果を得ようとするのならば、これら4つの脅威領域すべてに同時に対処する必要があります。

■ LLMセキュリティ vs 従来のアプリケーションセキュリティ

多くの組織は当初、既存のWebアプリケーションファイアウォール(WAF)、APIゲートウェイ、クラウドセグメンテーションツールがあればLLMの導入を安全に保護できると考えがちです。これらの対策は依然として必要ですが、それだけでは十分ではありません。

従来のセキュリティは、決定論的なコードパスの保護に重点を置いていますが、LLMセキュリティは、確率的な解釈エンジンの保護に重点を置きます。

従来のツールは、構造化された入力に対して既知の脆弱性の兆候を検査します。LLMセキュリティツールは、自然言語の意図と文脈操作を評価する必要があります。

従来のAPI保護では、認証とレート制限が適用されます。LLMファイアウォールは、推論を行う前にプロンプトを検査し、ユーザに渡る前に出力を分析する必要があります。

従来のシステムは静的なルール適用を前提としていますが、LLM環境では実行時の適応的なポリシー評価が必要です。

これらの違いを理解することが、効果的なLLMアプリケーションセキュリティアーキテクチャを構築する上で不可欠です。

■ エンタープライズLLMアプリケーションセキュリティアーキテクチャ

企業におけるLLMセキュリティは、4階層からなる階層型アーキテクチャとして実装されるべきです。

ユーザインタラクション層では、プロンプト検証、ユーザIDベースの制御、セッション管理によって基本的な保護を確立します。入力は認証済ユーザのみに限定し、明らかなインジェクションパターンを排除するようにフィルタリングする必要があります。

アプリケーション層およびAPI層では、認証、認可、レート制限、トークン検査によって、モデルに接続されたサービスの不正利用を防止します。この層は、モデルによってトリガーされる下流のAPI呼び出しが正当かつ制限されていることを保証します。

モデルおよび推論層では、AIに対応した強制機能が中心となります。LLMファイアウォールまたは同等のランタイム検査メカニズムは、実行前にプロンプトを評価し、インジェクションの試みを検出し、ポリシー境界を強制し、出力がユーザに返される前または自動化システムに渡される前に検査する必要があります。行動監視により、異常なインタラクションパターンを特定することで、LLMの脅威を検出できます。

インフラストラクチャ層では、セグメンテーション、DDoS攻撃対策、ロードバランシング、高可用性制御によってレジリエンス(復旧力)が確保されます。AIワークロードは、高需要下でも可用性を維持し、大量のトラフィック攻撃から保護される必要があります。

これらのどのレイヤが省略されても、企業のLLMセキュリティ体制は著しく弱体化するでしょう。

推論環境を保護するためのAIファイアウォールについて、詳しくはこちらをご覧ください。

■ LLMセキュリティツールの評価方法

AIソリューションの急速な普及により、LLMセキュリティツールの市場は細分化されてしまっています。企業は、体系的な基準を適用してそれらツールを評価すべきです。

第一に、プロンプト検査機能について評価します。このソリューションは、推論実行前にプロンプトインジェクションや命令の上書きを検出できますか?

第二に、出力検証を評価します。このツールは応答ポリシーを適用し、機密情報を動的に削除できるでしょうか?

第三に、推論層の統合についての検討です。アプリケーションの境界部分のみで動作するソリューションでは、モデルの動作を可視化することはできません。

第四に、インフラのスケーラビリティを考慮しなければなりません。エンタープライズレベルのLLM導入には、高いパフォーマンスと低遅延が求められるからです。

第五に、既存のSOCワークフローとの統合が必要です。LLMの脅威検出結果は、インシデント対応を支援するために、集中監視システムへ提供される必要があります。

最高のLLMセキュリティツールは、ランタイム検査、ポリシー適用、およびインフラレベルのレジリエンス(復旧力)を兼ね備えているべきです。

■ ベストなLLMセキュリティツール 2026年版

2026年における最も効果的な企業戦略は、複数のツールカテゴリーを統合したものとなるでしょう。

- AIガードレール製品を使えば、不適切な回答を抑えたり、出力をフィルタリングしたりできます。これらは価値のある機能ですが、あくまで「生成される内容」のチェックに留まってしまうという限界があります。

- APIセキュリティプラットフォームは、推論エンドポイントを認証情報の悪用やトラフィックの異常から保護します。境界防御を強化する一方で、モデルに関する詳細な認識能力は不十分といえます。

- クラウド独自のセキュリティ機能は、ネットワークの切り分けやシステムの安定稼働(可用性)を守るためのものです。これらはレジリエンス(復旧力)を確保する上では不可欠ですが、やり取りされるプロンプトや生成回答の中身まではチェックしません。

- LLMファイアウォールは推論層で直接動作します。実行前にプロンプトを検査し、生成後に出力を評価することで、AI対応のセキュリティ対策を実現します。APIセキュリティおよびインフラストラクチャ制御と統合することで、エンタープライズLLMセキュリティの中核を形成します。

エンタープライズグレードの保護を実現する、A10のLLMセキュリティおよびAIガードレールソリューションはこちらからご覧いただけます。

■ エンタープライズLLMセキュリティのベストプラクティス

LLMセキュリティに関する包括的なガイドの一環として、LLMセキュリティにおける上位5つのベストプラクティスをご紹介します。

- 大規模にAIを導入する組織は、モデルに接続されたすべてのシステムにおいて、最小権限のアクセス制御を実装する必要があります。ベクトルデータベースと検索レイヤは、必要なデータのみを公開しなければなりません。

- 推論プロセスが開始される前に、プロンプトが妥当か、そして参照範囲(コンテキスト)が適切に制限されているかを確認してください。また、生成された回答がユーザや後続の自動化システムに送られる直前には、必ず出力の検証を行う必要があります。

- 推論に関するやり取りは継続的にログに記録し、監視する必要があります。LLMの脅威検出は、可視性を確保するためにSOCのワークフローに統合されなければなりません。

- 定期的な敵対的テストとレッドチーミングは、攻撃者が脆弱性を悪用する前にそれを特定するのに役立ちます。

- 企業におけるLLMのセキュリティは、一度設定すれば済むようなものではありません。それは、継続的に取り組むべき運用の規律なのです。

■ A10ネットワークスによるAIインフラストラクチャ保護

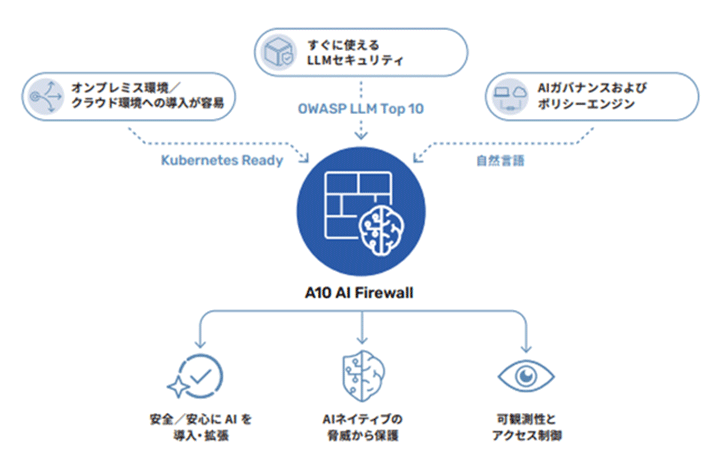

A10 ネットワークスは、AIに対応した強制機能とインフラストラクチャのレジリエンス(復旧力)確保を組み合わせることで、エンタープライズグレードのLLMサイバーセキュリティを提供します。

A10のAIファイアウォールソリューションは、実行時にプロンプトとレスポンスを検査し、推論レイヤでのポリシー適用を可能にします。APIセキュリティは、公開されたエンドポイントを不正利用から保護します。高性能なロードバランシングとDDoS攻撃対策により、オンプレミス、ハイブリッド、マルチクラウド環境全体でAIワークロードの可用性を確保します。

A10は、LLMアプリのセキュリティと既存インフラの制御を一本化します。これにより、企業はリスクを最小限に抑えつつ、AIの活用範囲を安全に広げていくことが可能になります。

■ エンタープライズAIの未来を安全に

LLMセキュリティはもはや選択肢ではなく必須事項です。大規模言語モデルが基幹業務システムに組み込まれるにつれ、他のミッションクリティカルなインフラストラクチャと同様の厳格なセキュリティ対策を講じる必要があります。

階層型エンタープライズLLMセキュリティの導入、AI対応の強制メカニズムの展開、LLM脅威検出、これらを統合した企業セキュリティの強固な基盤を築くことが、組織のイノベーションのために必要といえるでしょう。

専用に設計されたLLMセキュリティツールとAIファイアウォールの適用により、AIスタックを保護します。